Von: mk

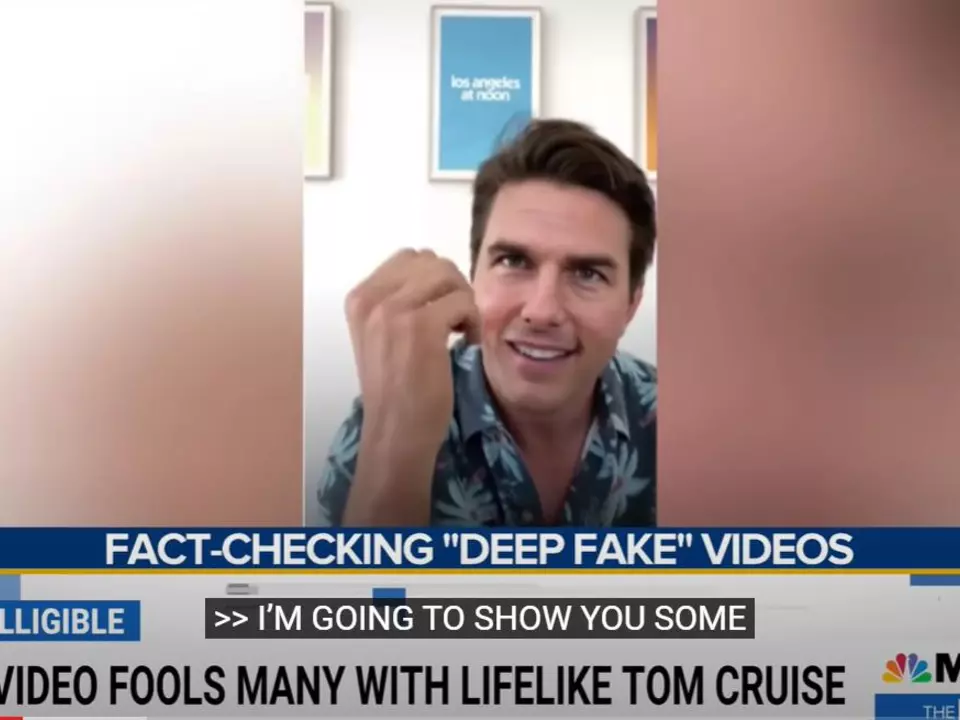

Das erste Video von Tom Cruise auf der Plattform TikTok, das Ende Februar veröffentlicht worden ist, zeigt nicht den Schauspieler selbst. Trotzdem wurde es ein viraler Hit im Internet und beunruhigt die Fachwelt gleichermaßen. Der Grund dafür: Es handelt es sich um ein sogenanntes Deepfake-Video.

Bislang galten Videos deutlich weniger anfällig für Manipulationen wie Fotos, die heutzutage nahezu jeder digital mit Photoshop bearbeiten kann. Das könnte sich nun ändern.

Bei Deepfakes handelt es sich um Videos, in denen ein Computer das Gesicht einer Person generiert. Eine Software wird mit möglichst vielen Fotos jener Person gefüttert, die abgebildet werden soll. Wie stern.de berichtet, lernt ein Algorithmus anhand der Bilder, die Mimik, Mund- und Augenbewegungen der Person exakt nachzuahmen.

Anschließend legt das Programm das Ergebnis wie eine digitale Maske in einer Videoaufnahme über das Gesicht einer anderen Person.

Da von Schauspielern und Politikern in der Regel viele Fotos öffentlich zur Verfügung stehen, eignen sich diese für Täuschungen solcher Art besonders. Im Prinzip wäre es anhand von Deepfakes möglich, etwa einem führenden Staatsmann, Personen des öffentlichen Lebens oder politisch engagierten Menschen Aussagen in den Mund zu legen, die sie nie gemacht haben.

Während die Technologie vor zwei Jahren noch relativ unausgereift war, wird es mittlerweile immer schwieriger, Deepfakes zu erkennen.

Nur wer genau hinschaut, bemerkt einige Ungereimtheiten. So sieht der echte Tom Cruise mit 58 Jahren deutlich älter aus. Außerdem gibt es kleine Bildfehler: Beim Absetzen der Sonnenbrille verschwindet etwa für eine Sekunde ein Bügel der Brille. Auch die Stimme klingt anders.

Die Macher des Clips behaupten, sie hätten die Aufmerksamkeit der Öffentlichkeit auf das Thema lenken wollen. In der Zwischenzeit wurden die Videos des Users „deeptomcruise“ vom TikTok-Kanal gelöscht. Internet-Sicherheitsexperten zeigen sich trotzdem besorgt über den Einsatz von künstlicher Intelligenz in sozialen Medien und den weiteren Entwicklungen.

In den USA hat erst kürzlich das FBI vor realistischen Deepfakes gewarnt. Die Palette der Gefahren reicht von harmlosem Unfug über Verbrechen bis hin zu wahren Cyberkriegen. Die gezinkten Videos könnten für Betrugsversuche per E-Mail eingesetzt werden, um möglicherweise sogar militärische Informationen abzuschöpfen. Auch Mitarbeiter eines Unternehmens könnten ausgetrickst und überredet werden, die normalen Sicherheitsvorkehrungen zu umgehen und sensible Informationen preiszugeben.

Autorin Nina Schick, die sich mit dem Thema auseinandergesetzt hat, definiert Deepfakes als Videos, die von künstlicher Intelligenz manipuliert oder komplett erzeugt wurden. Sie rechnet damit, dass innerhalb der nächsten zehn Jahre unser Informationsökosystem mit künstlich erzeugten Medieninhalten regelrecht überflutet wird.

Für das Publikum werde es immer schwieriger zu erkennen, was real ist und was nur am Computer synthetisiert wurde. Künstliche Intelligenz habe einerseits die Fähigkeit, etwas völlig Neues zu generieren, andererseits aber auch das Äußere von existierenden Menschen bis ins kleinste Detail zu kopieren.

Laut Nina Schick laufen alle Personen Gefahr, Opfer von Deepfakes zu werden, die ein öffentliches Profil auf einem sozialen Netzwerk haben. Dabei müsse es sich nicht zwangsläufig um bekannte Persönlichkeiten handeln.

„Einerseits erfährt der technologische Fortschritt eine rasante Beschleunigung. Die zweite beunruhigende Sache ist, dass jeder Zugriff auf die Technologie haben wird. Nicht nur Hollywood-Studios werden Deepfakes produzieren können, sondern jeder, der in zehn Jahren ein Smartphone besitzt und sich eine entsprechende App herunterlädt“, ist Schick überzeugt.

Sie rät dazu, wachsam und kritisch zu bleiben, ohne zynisch zu werden. Gleichzeitig verlangt sie nach technischen Lösungen, die es Nutzern ermöglichen, echte Videos von gefakten zu unterscheiden.

Auch Unternehmerin und Cyber-Security-Spezialistin Rachel Tobak fordert Plattformen wie TikTok auf, Software einzusetzen, die Deepfakes erkennen und diese auch kennzeichnen. Ihrer Ansicht nach untergraben Deepfakes das öffentliche Vertrauen. Sie bieten Kriminellen, die mittels Videoaufnahmen überführt werden, Deckung und plausible Ausreden. Die gefälschten Videos würden verwendet, um Menschen zu manipulieren, zu demütigen und zu verletzen.

Eine Möglichkeit, um visuellen Manipulationen vorzubeugen, wären sichtbar auffällig verifizierte Accounts von Prominenten, selbst wenn sie auf der Plattform nicht aktiv wären. Nicht verifizierte Accounts, wie etwa jener von „deeptomcruise“ stünden dann automatisch unter Verdacht, Täuschungen zu verbreiten.